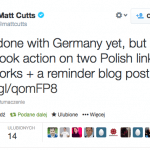

Po niedawnym tweecie Matta Cuttsa informującym o działaniach podjętych przeciwko dwóm polskim systemom linków oraz wczorajszym zbadaniu sytuacji, gdzie okazuję, że działania nie były skierowane przeciw systemom, tylko przeciw wydawcom, zarówno tym zrzeszonym w systemach, jak i tym, którzy nic z systemami nie mieli wspólnego, można ocenić zasięg podjętej akcji przez Google.

Dlaczego trzymam się wersji, że nie były to dwa konkretne systemy? Po pierwsze Matt miał w zwyczaju podawać nazwę sieci, która została namierzona przez jego zespół. Tym razem nie podał żadnej nazwy. Może miał na myśli generyczność danego systemu, czyli charakter emisji linków, a ta może być dwojakiego rodzaju, rotacyjna lub stała, trudno powiedzieć. Drugi twardy dowód, że akcja nie dotyczy precyzyjnie tylko dwóch systemów, to usuwanie z indeksu wyszukiwarki stron, które z żadnym systemem nie są związane.

Po przeliczeniu próbki około 29 tys. domen, które miały styczność z systemami, co jest jak najbardziej próbą wystarczającą do oceny skali zjawiska, okazuje się, że około połowa z nich przestała istnieć w indeksie Google. Druga połowa stron nadal jest widoczna w wyszukiwarce. Co sprawia, że działania Google są połowiczne? Odpowiedź jest oczywista, choć może nieco niezrozumiała dla wszystkich, bo ma podłoże czysto matematyczne.

Linki emitowane w systemach rotacyjnych mają charakter temporalny. Nowa strona podłączona do systemu, zanim zostanie zauważona przez Google, że emituje linki, żyje spokojnie kilka miesięcy. W tym czasie, średnio co 24 – 72 godziny następuje aktualizacja paczek linków. Często paczki linków zawierają linki do tej samej domeny. Googlebot nie odwiedza stron podłączonych do systemów codziennie. Dopiero po przekroczeniu pewnej masy krytycznej, obliczanej na podstawie różnic w wyświetlanych linkach oraz rosnącej sumie niezależnych domen wskazywanych przez te linki, reguły wychwytujące nienaturalne linkowanie dostrzegają stronę emitującą linki. Jednak do tego potrzeba czasu, który zwykle wynosi co najmniej 3 do 6 miesięcy. To jedna reguła, która tłumaczy, dlaczego pewne strony nie znikają indeksu.

Jest jeszcze zjawisko, które dostrzegam, dla stron ze starszym stażem, ale mają nietypowe, nieklasyczne linkowanie zdobyte dla nowo rejestrowanej domeny. W tym przypadku, domena również nie łapie się w reguły wychwytujące nienaturalne linkowanie.

Oczywiście mogę się mylić w swojej ocenie. Jakie jest wasze zdanie o zasięgu przeprowadzonej akcji?

Zapisz się na newsletter wypełniając pola poniżej. Będziesz na bieżąco ze wszystkimi wydarzeniami związanymi z Silesia SEM i informacjami o marketingu internetowym w sieci. Nie spamujemy.

Zostanie wysłany do Ciebie e-mail potwierdzający: przeczytaj zawarte w nim instrukcje, aby potwierdzić subskrypcję.

Artur Strzelecki

Ostatnie wpisy Artur Strzelecki (zobacz wszystkie)

- Black Friday SEO 2025 - 28 listopada 2025

- Druga część webinaru z autorami książki „SEO w praktyce” - 25 listopada 2025

- Rewolucja w wyszukiwaniu: tryb AI Google wkracza do Polski – co musisz wiedzieć? - 8 października 2025

Wygląda na to, że połowa weblinka dostała bana ?

Jeżeli chodzi o bany to ja to widzę w ten sposób: Google ma algorytm do wykrywania spamu (ciągle go ulepsza), strony które trafią dzięki niemu na czarną listę siedzą tam jakiś czas i są pod lupą zespołu SQT, który te strony sprawdza. Zespół ten ma za zadanie zweryfikować te witryny czy algorytm słusznie uznał ich za spam, niestety trwa to kilka nawet miesięcy i dlatego banów nie ma tak często na taką skalę. Po tych kilku miesiącach kiedy Matt zna już liczbę stron które niebawem znikną z Google oznajmia przeddzień o planowanej akcji, którą już tak na prawdę przeprowadzili.

A i jeszcze nawiązując do tytułu wpisu – jest chwytliwy ale może wprowadzać w błąd 🙂

Ładna próbka:) Do różnych teorii dodałbym jeszcze jedną – Google ma fioła na punkcie optymalizacji (zasobów), dlatego stara się minimalnym nakładem pracy osiągnąć maksymalny efekt. Jeśli przebiję Ci dwie opony w samochodzie – nigdzie nie pojedziesz, nie muszę przebijać wszystkich czterech, a gdy przebiję tylko jedną, masz zapas 😉

Jak rzadko komentuje komentarze, tak spodobał mi się pomysł przebicia dwóch opon.

Ja zawsze w takich sytuacjach sobie powtarzam, że (tak długo, jak organiczne wyniki nie zostaną zupełnie wypchnięte przez płatne), ktoś tę 10 musi wypełnić :-). Teraz dużo osób płacze, ale takie akcje i tak zostawiają wszystkim z grubsza równe szanse. Ci, którzy od zawsze pracowali sprytniej i mądrzej, teraz pewnie nadal będą przed tymi, którzy wolą narzekać.

Może powrócą strony do wyników nie linkowane ewebem, mam nadzieję

@techformator – skąd takie informacje że skala jest większa? Uważasz że 29 tys. domen to za mała próbka? A może znowu szukasz spisku ?

Mówimy o 29 tys. domen, czy serwisów, bo to istotna różnica? Utrata dużej subdomen nie jest mocnym ciosem w system. Przypomnę, że rok temu z 70-80% domen zostało zbanowanych w ciągu paru tygodni. Jedyna różnica między dzisiejszymi wydarzeniami, a tamtymi był post Matta.

Poprawcie fonty, bo pl znaków nie obsługują.

=> http://i.imgur.com/bLxDqw8.png <= bardziej we wpis się nie dało wepchać formularza newslettera? W którym miejscu kończy się wpis? ;P

@Janek, mam oczy, potrafię analizować i widzę co jest grane, znajomi też potwierdzają, że skala jest znacznie większa od tego co oficjalnie mówi się, a od spisków jest Xann i jego świta nie ja. Pozdrawiam!

Ja zastanawiam się nad tym: skoro taka ilość domen zniknęła z Google, dlaczego tak niewielkie zmiany były w SERPACH? Na tyle, na ile jestem w stanie wyciągnąć coś z moich obserwacji, zmiany były niewielkie. A ucierpiało – z tego co obserwuję – chyba najwięcej katalogów.